Ollama简介

Ollama 是一个基于 Go 语言开发的可以本地运行大模型的开源框架,只需一条命令即可在本地跑大模型。开源项目,专注于开发和部署先进的大型语言模型(LLM)。

官网:https://ollama.com/

GitHub 地址:https://github.com/ollama/ollam

特点

1)开源:

Ollama 是一个完全开放源代码的项目,这意味着任何人都可以查看、修改和贡献代码。

2)易用性:

项目旨在简化语言模型的训练和部署流程,使得即使是那些没有深度学习背景的人也能轻松使用。

3)高性能:

Ollama 支持高效地训练和运行大规模的语言模型,利用现代硬件加速计算。

功能

1)模型训练

提供工具和指南来训练自己的语言模型。

2)模型部署

提供部署语言模型的工具,使其能够在生产环境中使用。

3)社区支持

社区成员可以分享经验、技巧,并共同改进项目的各个方面

Ollama安装和部署

Ollama API

Ollama 相关命令

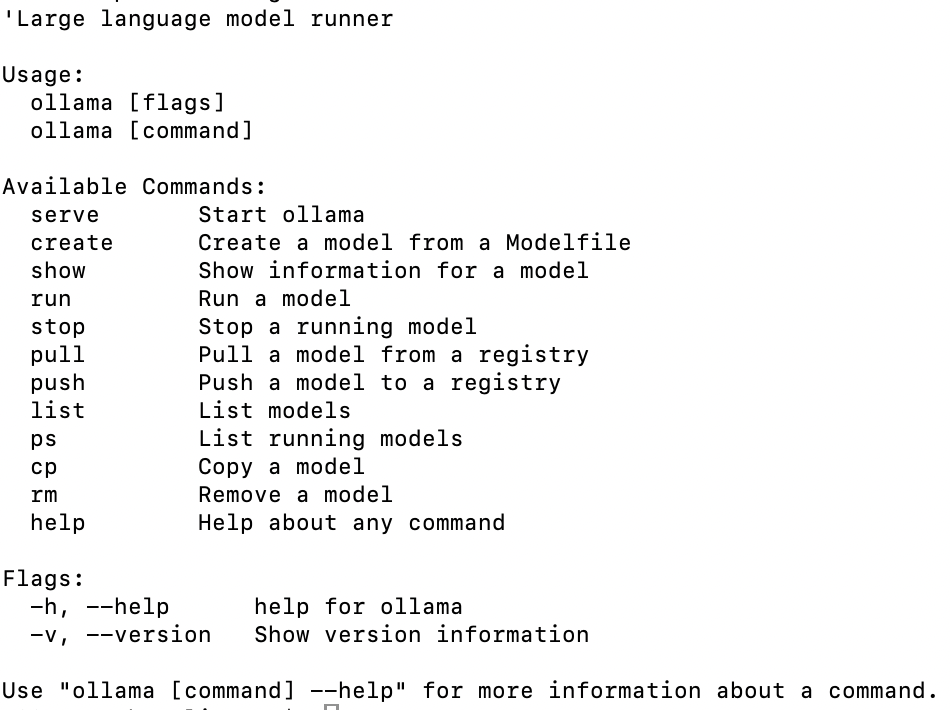

1.ollama 帮助

ollama -h 如图

2.运行和停止模型

llama3.1是一个开源的大模型,该模型家族中有8B、70B和405B的模型,这里我们运行一个比较小的模型。运行该命令会先去下载大模型,然后在本地运行起来,这个过程需要花费一定的时间。

ollama run llama3.1

# ollama run llama3.1:70b

# ollama run llama3.1:405b

3.停止模型

# 查看模型信息

ollama show llama3.1

# 查看运行中的模型:

ollama ps

# 查看本地模型:

ollama list

4.模型相关操作命令

#拉取模型,拉取的模型会存放当前用户主目录的.ollama文件夹下。可通过修改OLLAMA_MODELS环境变量更改安装目录。

ollama pull codellama

#拷贝模型:

ollama cp codellama codellama.copy

#删除模型:

ollama rm codellama.co